Batch Normalization,和普通的數據標準化類似,是將分散的數據統一的一種做法,也是優化神經網路的一種方法。具有統一規格的數據,能讓機器學習更容易學習到數據之中的規律。

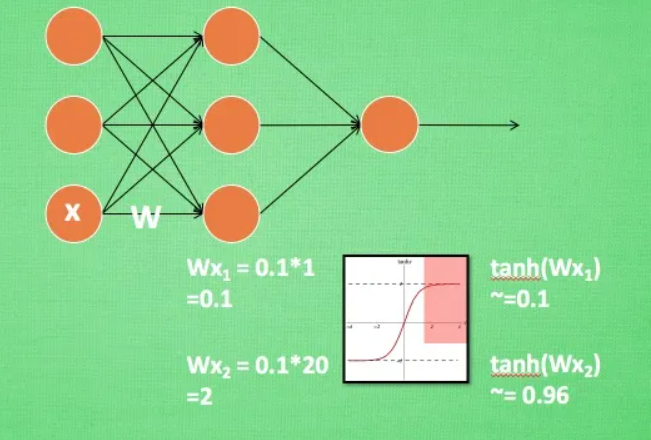

在神經網路中,數據分布對訓練會產生影響,比如某個神經元x 的值為1,某個 Weights 的初始值為 0.1,這樣後一層神經元計算結果就是 Wx = 0.1; 又或者 x = 20,這樣 Wx 的結果就為2。現在還不能看出什麼問題,但是,當我們加上一層激勵函數,激活這個Wx 值的時候,問題就來了。如果使用像 tanh的激勵函數,Wx的激活值就變成了 ~0.1 和 ~1,接近於 1的部分已經處在激勵函數的飽和階段,也就是如果x無論再怎麼擴大,tanh激勵函數輸出值也還是接近1。換句話說,神經網路在初始階段已經不對那些比較大的x 特徵範圍敏感了。這樣很糟糕,想像我輕輕拍自己的感覺和重重打自己的感覺居然沒什麼差別,這就證明我的感官系統沒有功用了。當然我們是可以用之前提到的對數據做 normalization 預處理,使得輸入的 x變化範圍不會太大,讓輸入值經過激勵函數的敏感部分。但剛剛這個不敏感問題不僅僅發生在神經網路的輸入層,而且在隱藏層中也經常會發生。

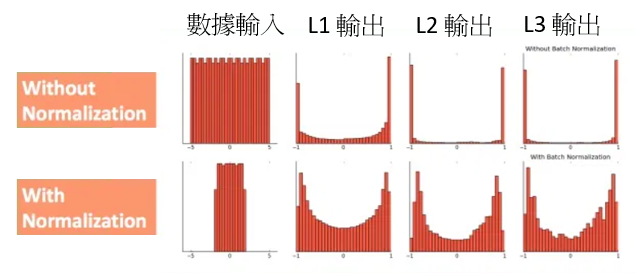

圖1 每層都做標準化

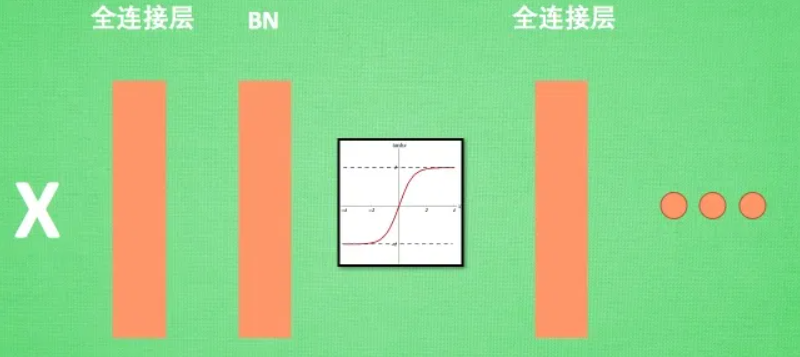

只是有時候x換到了隱藏層當中,我們能不能對隱藏層的輸入結果進行像之前那樣的normalization 處理呢?答案是可以的,就叫做 batch normalization,正是處理這種情況。

Batch normalization的 batch是一批數據,把數據分成小批小批進行stochastic gradient descent。而且在每批數據進行前向傳遞 forward propagation 的時候,對每一層都進行 normalization 的處理。

圖2 Batch Normalization添加位置

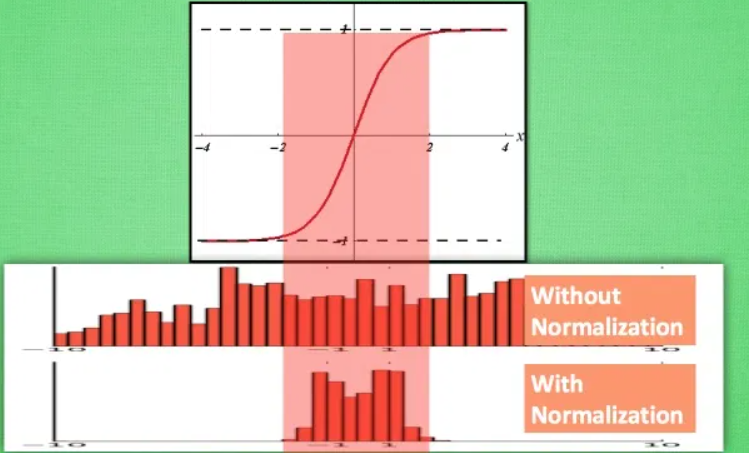

計算結果在進入激勵函數前的值很重要,如果我們不單單看一個值,我們可以說,計算結果值的分布對於激勵函數很重要。對於數據值大多分布在這個區間的數據,才能進行更有效的傳遞,對比這兩個在激活之前的值的分布。上者沒有進行 normalization,下者進行了 normalization,這樣當然是下者能夠更有效地利用 tanh進行非線性化的過程。

圖3 Batch Normaliztion效果

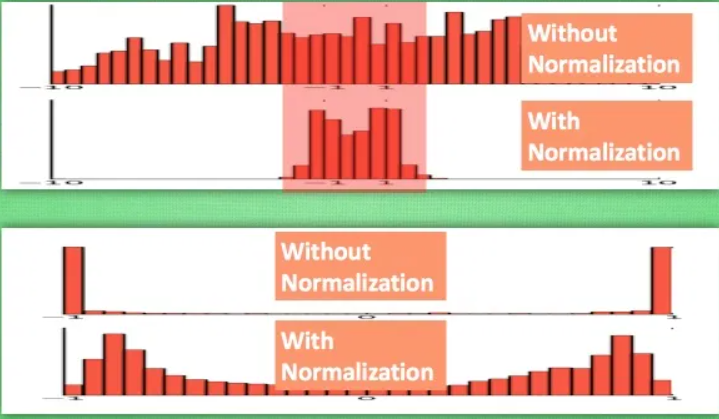

沒有 normalize的數據使用 tanh激活以後,激活值大部分都分布到了飽和階段,也就是大部分的激活值不是-1就是1而 normalize 以後,大部分的激活值在每個分布區間都還有存在。再將這個激活後的分布傳遞到下一層神經網路進行後續計算,每個區間都有分布的這一種對於神經網路就會更加有價值。Batch normalization不僅僅 normalize 了一下數據,他還進行了反 normalize 的手續。

圖4 反Normalization

我們引入一些batchnormalization 的公式,這三步就是我們在剛剛一直說的 normalization 程序,但是公式的後面還有一個反向操作,將 normalize 後的數據再擴展和平移。原來這是為了讓神經網路自己去學著使用和修改這個擴展參數 gamma和 平移參數 β, 這樣神經網路就能自己慢慢琢磨出前面的 normalization 操作到底有沒有起到優化的作用,如果沒有起到作用,我就使用 gamma和 belt來抵消一些 normalization 的操作。

圖5 Batch Normalization 公式

最後來看看一張神經網路訓練到最後,代表了每層輸出值的結果的分布圖,這樣我們就能看出 Batch normalization 的功效。讓每一層的值在有效的範圍內傳遞下去。

評論