在使用人工智慧(AI)之前,使用特定演算法:每個工程師必須開不同的演算法,使用不同的濾波器,去準確達到人臉偵測、人臉校正、人臉特徵值的擷取以達到人臉辨識效果。這種方法非常的曠日廢時。而且會因不同的硬體架構,不同的硬體加速,必須修改不同的演算邏輯,或是運動不同的濾波器。所以,此種方式的人臉辨識在跨平台上的應用就會有所限制。而現在廣泛使用人工智慧(AI)技術來實現人臉辨識。

所謂的人工智慧(AI)是電腦科學的一個領域,達到學習、解決問題和模式辨識。在這過程中必須讓電腦可以做到"機器學習(ML)"甚至"深度學習(DL)"。機器學習 (ML) 和深度學習 (DL) 這都是需要強大運算能力的t超級電腦與龐大的資料庫。因此,以前的人工智慧(AI)系統架構,必須與雲端平台(例如AWS, Google..)連線才能實現。而為了使終端設備(Edge)在不聯網的情境下也能實現人工智慧(AI), 許多開源公司開始開發?有的學習模型(Model Firmwork)並提供產業界使?。但仍亟需解決的問題:如何整合各家開源公司所提供的學習模型(Model Firmwork)。

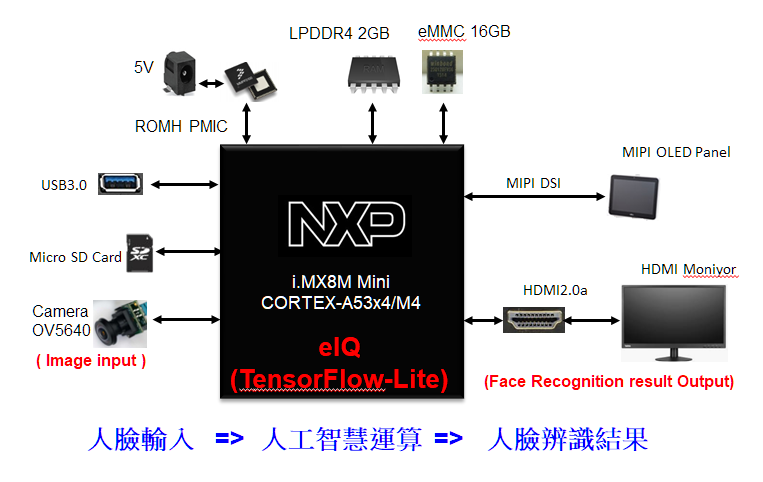

以下為基於NXP i.mx8m mini的人工智慧架構下之人臉辨識解決方案:

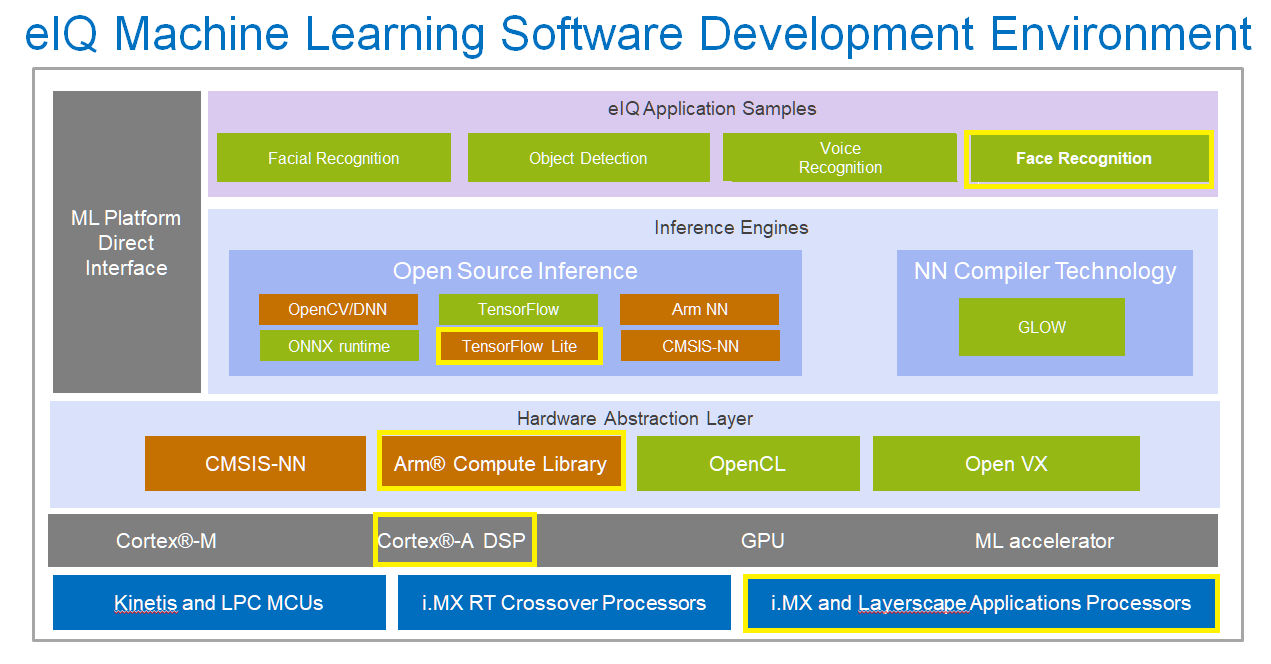

在此方案中,先介紹eIQ( edge Intelligence Quotient )這個軟體的平台。其主要功能為在edge端直接inference(推理) 學習模型(Model Firmwork),並得出計算出最終結果。在不同的開源公司中,其學習模型(Model Firmwork)也有所不同。

例如:TensorFlow/TensorFlow Lite: 由谷歌(Google)提供的 Model framework, Caffe/Caffe2: 由臉書(Facebook)提供的 Model framework。

eIQ軟體的平台, 整合?前流?的故種不同的開源學習模型,根據各家開源學習模組所擅?的領域,可以直接在NXP產品(MPU與MCU)上執?並且完全不受?擾可獨立的進?運作,替客?節省成本以及開發時程。 如下:

在此架構下:

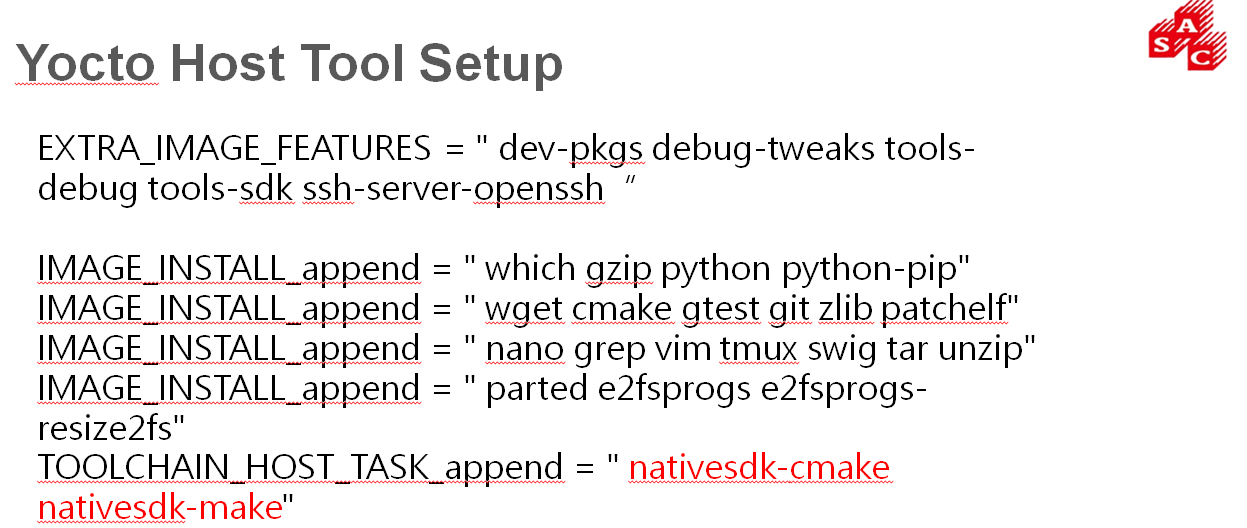

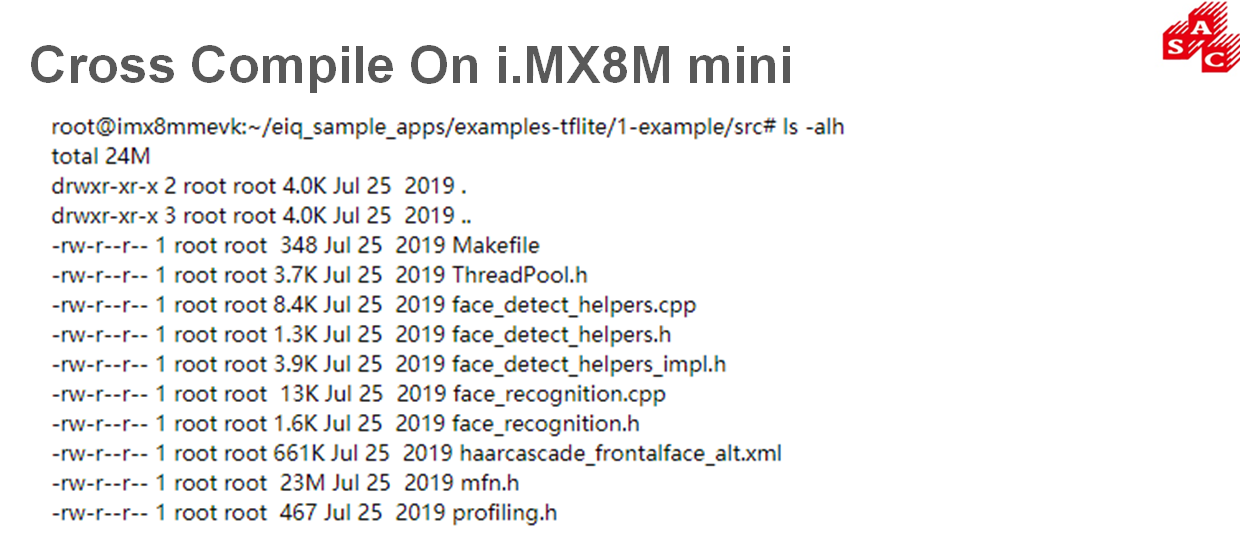

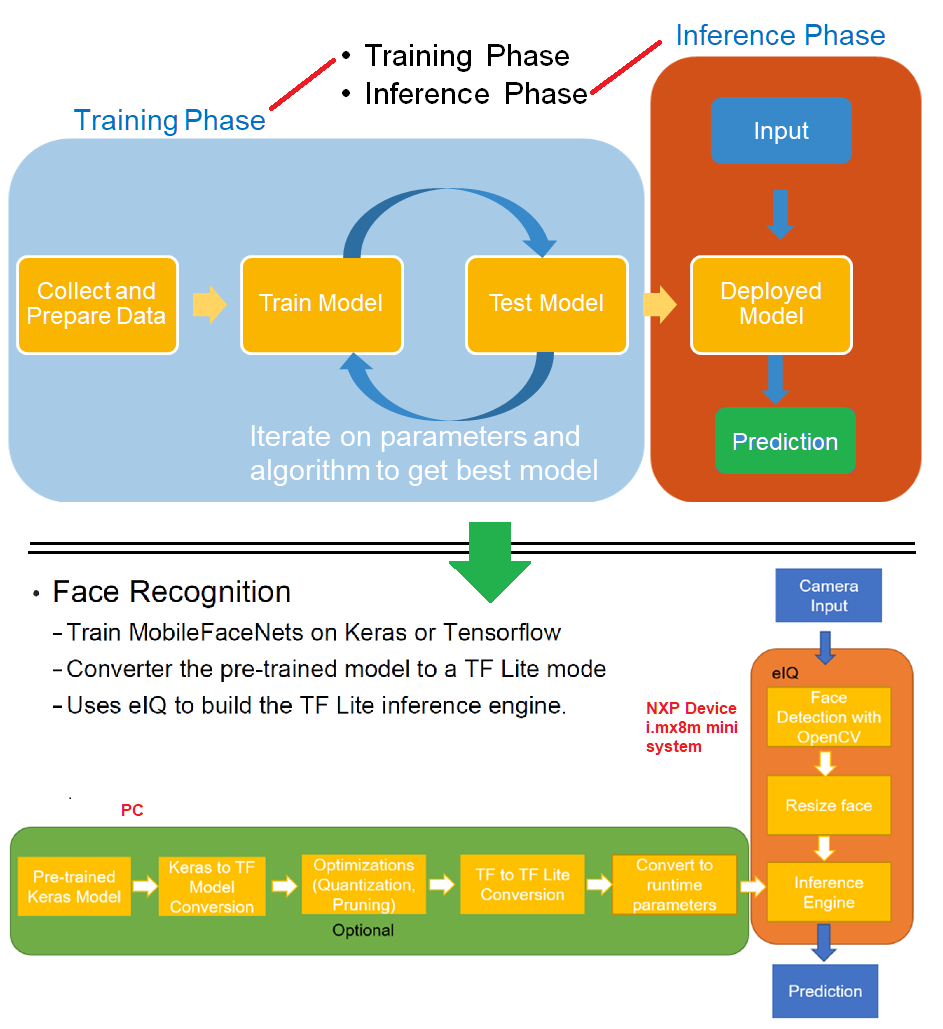

品佳集團將教導客戶在Linux Kernel 4.14.98的基礎上,使?Yocto Project開發環境,如何編譯Opencv, tensorflow-lite等應?程式及學習庫 。接著整合TensorFlow的機器學習過程,訓練"MobilFaceNets"模型,將其轉換成在TensorFlow Lite人臉辨識學習模型。在Yocto Project開發環境,整合eIQ人工智慧軟體系統。並將上訴得到的人臉辨識學習模型 inference(推理) 致i.mx8m mini的系統架構之中。這樣一來,客戶即可以在i.mx8m mini的系統架構實現人臉辨識的功能。

以下為部分工具架設與程式碼編譯:

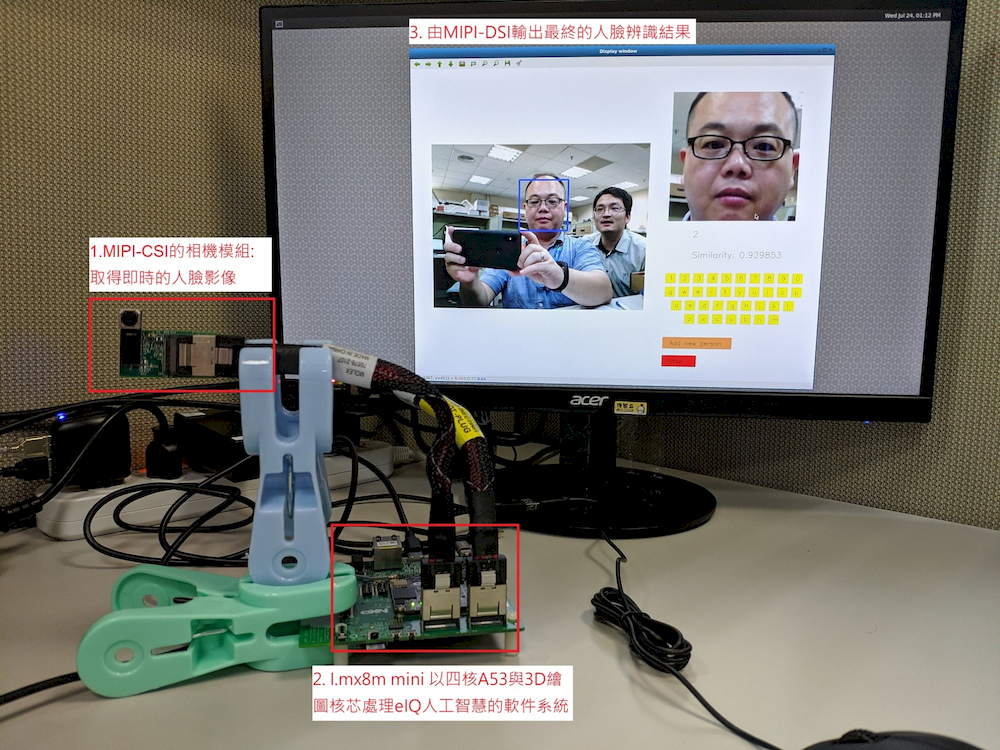

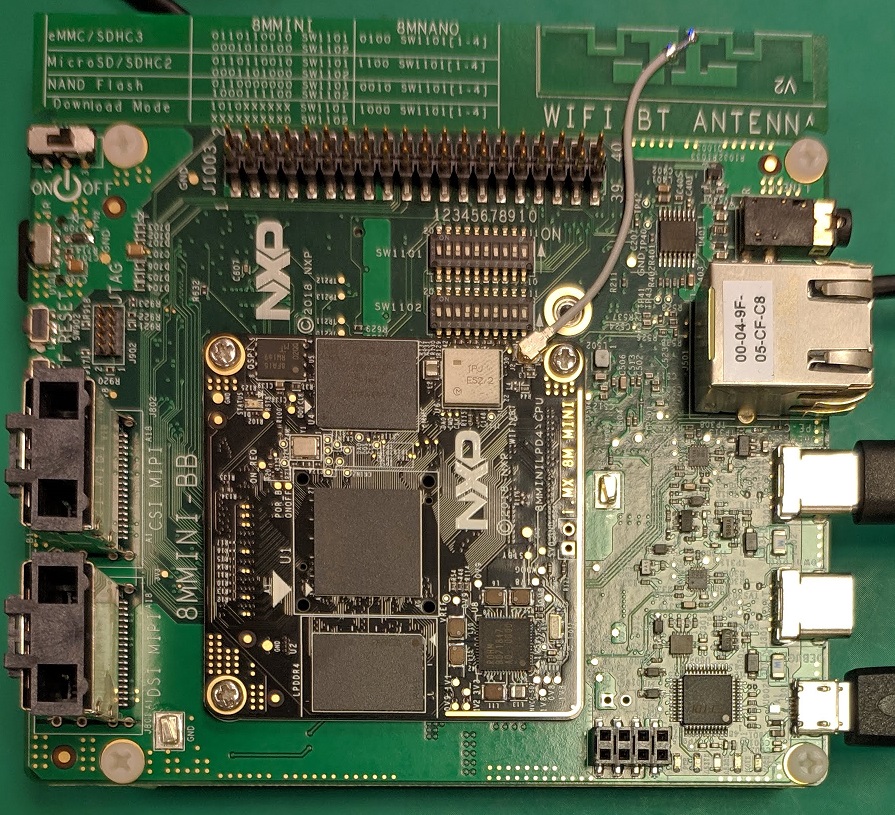

硬體實現如下:

應用MIPI-CSI的相機模組,取得即時的人臉影像。並加人臉影像傳輸到恩智浦的處理芯片i.mx8m mini。i.mx8m mini運用芯片中的處理器四核A53(1.6GHz)核芯 與繪圖器GC NanoUltra 3D的加成運算能力,運行eIQ人工智慧軟體系統,達到人臉辨識的功能。可以由MIPI-DSI輸出得到判讀得結果。

►場景應用圖

►展示板照片

►方案方塊圖

►核心技術優勢

i.mx8m mini 系統: ◆ 低功耗且可擴展的性能:處理核心A53可以由單核擴展至四核。並可微處理器M4單獨執行,達到更低的功耗。 ◆ 強大多媒體功能 音頻/聲音/視頻:內建影音1080P的編碼語解碼。聲音解碼可以支持DOLBY ATMOS與DTSX。 ◆ 廣泛的系統連通性:支持各種傳輸介面(MIPICSI, MIPI-DSI, USB, SDIO, PCIE),系統連通性更廣泛。 eIQ 軟體平台: 目的是使客戶能夠開發機器學習應用程序。 ◆ 專注於部署開源推論引擎 ◆ 集成到我們的標準軟件版本中(Yocto Linux BSP,MCUXpresso SDK) ◆ 支持軟體材料更新,易於使用與開發

►方案規格

◆ 處理器:A53(1.6GHz) x4,M4(400MHz) x1 ◆ 儲存器:x16/x32 位元 LPDDR4/DDR4/DDR3L ◆ 繪圖器:GC NanoUltra 3D (1 shader) + GC320 2D ◆ 顯示介面:MIPI-DSI ◆ 影像輸入介面:1x MIPI-CSI (4-lanes) ◆ 解碼器:1080p60 HEVC H.265, VP9, H.264, VP8 ◆ 編碼器:1080p60 H.264, VP8 ◆ 聲音介面:20x I2S TDM (32b @384KHz) ◆ 一搬介面:USB2.0 x2,SDIO x3,Ethernet x1,PCIE2.0 x1